* 용어 정리

1) 독립 변수

- 다른 변수에 영향을 받지 않고 독립적으로 변화하는 수, 설명 변수라고도 함

- 입력 값이나 원인을 나타내는 변수, y = f(x) 에서 x에 해당 하는 것

2) 종속 변수

- 독립 변수의 영향을 받아 값이 변화하는 수, 분석의 대상이 되는 변수

- 결과물이나 효과를 나타내는 변수, y = f(x)에서 y에 해당 하는 것

3) 잔차(오차항)

- 계산에 의해 얻어진 이론 값과 실제 관측이나 측정에 의해 얻어진 값의 차이

- 오차(Error) : 모집단, 잔차(Residual) - 표본 집단

* 회귀 분석

- 변수와 변수 사이의 관계를 알아보기 위한 통계적 분석 방법

- 독립 변수의 값에 의해 종속 변수의 값을 예측하기 위함

- 일반 선형회귀는 종속변수가 연속형 변수일 때 가능

- 이산형(범주형) - 명목, 서열척도

- 연속형 - 구간, 비율척도

* 선형 회귀 모형

- 종속변수 y와 한 개 이상의 독립변수 x와의 선형 상관 관계를 모델링하는 회귀 분석 기법

- 한 개의 독립 변수 : 단순 선형 회귀, 둘 이상의 독립 변수 : 다중 선형 회귀

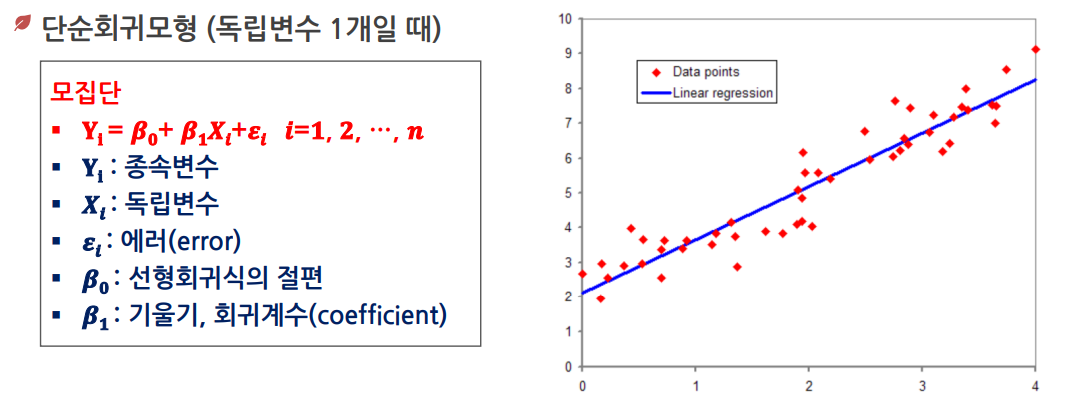

* 단순 회귀 모형 (독립 변수 1개일 때)

* 단순 회귀 분석 - 최소자승법(Least Square Method)

- Y = f(X)의 측정값 yi와 함수값 f(xi)의 차이를 제곱한 것의 합이 최소가 되도록 Y=f(x)를 구하는 것

- Y = aX + b 일 때 잔차를 제곱한 것의 합이 최소가 되도록 하는 상수 a,b를 찾는 것

- 즉, (측정값 - 함수값)^2의 합이 최소가 됟는 직선의 그래프를 찾는 것

- 큰 폭의 잔차에 대해 보다 더 큰 가중치를 부여하여, 독립변수 값이 동일한 평균치를 갖는 경우 가능한 한 변동 폭이 적은 표본 회귀선을 도출하기 위한 것.

* 다중 공선성(Multicollinearity)

- 모형의 일부 설명변수(=예측변수)가 다른 설명변수와 상관되어 있을 때 발생하는 조건

- 중대한 다중공선성읜 회귀계수의 분산을 증가시켜 불안정하고 해석하기 어렵게 만들기 때문에 문제가 됨

- R의 vif함수를 사용해 구할 수 있으며, VIF값이 10이 넘으면 다중공선성이 존재한다고 봄

* VIF : Variance Inflation Factor

->해결 방법

- 높은 상관 관계가 있는 설명변수를 모형에서 제거함으로써 해결

- 설명변수를 제거하면 대부분 R-square가 감소

- 단계적 회귀분석을 이용하여 제거

* 설명변수의 선택 원칙

- y에 영향을 미칠 수 있는 모든 설명변수 x들은 y의 값을 예측하는 데 참여

- 설명 변수 x들의 수가 많아지면 고나리에 많은 노력이 요구되므로 가능한 범위 내에서 적은 수의 설명변수를 포함시켜야 한다.

- 두 원칙이 이율배반적이므로 적절한 설명변수 선택 필요

* 설명 변수의 선택 방법

| 모든 가능한 조합 | - 모든 가능한 독립변수들의 조합에 대한 회귀모형을 고려,AIC,BIC 기준으로 가장 적한한 회귀 모형 선택 - AIC, BIC : 최소자승법의 R^2와 비슷한 역할을 하며, 적합성을 측정해주는 지표로, R^2는 큰 값이 좋지만, AIC, BIC는 작은 값이 좋음 |

| 후진 제거법 | Backward Elimination, 독립변수 후보 모두를 포함한 모형에서 출발해 제곱한의 기준으로 가장적은 영향을 주는 변수로부터 하나씩 제거하면서 더이상 유의하지 않은 변수가 없을떄까지 설명변수를 제거하고, 이때 모형 선택 |

| 전진 선택법 | Forward Selection, 절편만 있는 모델에서 출발해 기준 통계치를 가장 많이 개선시키는 변수를 차례로 추가하는 방법 |

| 단계별 선택법 | Stepwise Method, 모든 변수가 포함된 모델에서 출발해 기준 통계치에 가장 도움이 되지 않는 변수를 삭제하거나, 모델에서 빠져 있는 변수 중에서 기준 통계치를 가장 개선 시키는 변수 추가 |

* 회귀 모델에서 변수 선택을 위한 판단 기준 : Cp, AIC, BIC 등이 있으며, 값이 작을수록 좋음

문제1 ) 다음 중 회귀 분석에서 변수선택에 대한 설명으로 가장 부적절한 것은?

1) 전진선택법은 중요하다고 생각되는 변수를 차례로 모형에 추가하는 분석 방법이다.

2) 후진제거법은 모든 설명변수를 포함한 모형에서 출발해 종속변수의 설명에 가장 적은 영향을 주는 변수부터 제거한다.

3) 단계적 선택 방법에 따른 결과는 전진선택법과 후진제거법의 결과는 항상 일치한다.

4) 후진제거법은 한번 제거된 변수는 다시 모형에 추가될 수 없다.

* 후진제거법 예시

* 후진제거법으로 분석 시 유의확률이 가장 높은 값부터 제거(=가장 적은 영향을 주는 변수부터 하나씩 제거)

- 유의확률 = p-value, 0<=p-value<=1, 1종 오류를 범할 확률, 귀무가설을 지지하는 정도

- 귀무가설이 사실일 때 기각하는 1종 오류시 우리가 내린 판정이 잘못되었을 확률

* p-value가 유의수준 5% 아래이면 통계적으로 유의한 모형

'개발 > Data Science' 카테고리의 다른 글

| 데이터분석 준 전문가(ADsP) 3과목 : 데이터 분석-시계열 예측 기초개념 (0) | 2023.02.23 |

|---|---|

| 데이터분석 준 전문가(ADsP) 3과목 : 데이터 분석-주성분분석(PCA) (0) | 2023.02.22 |

| 데이터분석 준 전문가(ADsP) 3과목 : 데이터 분석-모형평가 (1) | 2023.02.21 |

| 데이터분석 준 전문가(ADsP) 2과목 : 데이터 분석 기획 기초 개념 (0) | 2023.02.19 |

| 데이터분석 준 전문가(ADsP) 1과목 : 데이터 이해 기초 개념 (0) | 2023.02.18 |